Arten einfacher Prognosemethoden für das Corporate Treasury

1979 veröffentlichte der griechische Akademiker Spyros Makridakis eine Artikel im Journal der Royal Statistical Society. Der Artikel zeigte, dass einfache (traditionelle statistische) Prognosemethoden komplexere Methoden übertrafen. Zu dieser Zeit hatte die Zunahme der leicht zugänglichen Rechenleistung dazu geführt, dass sich neuere, rechnergestützte und offenbar genauere Prognosemethoden in Wirtschaft und Wissenschaft verbreitet hatten. Makridakis, der zu diesem Zeitpunkt Professor an der Stattdessen, stand dem wahren Wert dieser komplexeren Prognosemethoden skeptisch gegenüber, was ihn dazu veranlasste, die umfangreiche empirische Studie hinter dem Artikel in Angriff zu nehmen.

Die Ergebnisse der Studie von Makridakis wurden zu dieser Zeit vielfach kritisiert, vor allem aufgrund der Überzeugung, dass Komplexität und höhere Rechenleistung zu genaueren Ergebnissen führen müssen. Die anschließende Uneinigkeit führte zur Gründung der „M“ -Reihe von Prognosewettbewerben, bei denen die genauesten Prognosemethoden für verschiedene Arten von Vorhersagen gefunden werden sollten. Seit 1982 gab es insgesamt vier „M-Wettbewerbe“, von denen der letzte im Mai dieses Jahres abgeschlossen wurde. Der Gewinner dieses Wettbewerbs wird im Oktober bekannt gegeben.

40 Jahre später wurde eine ähnliche Debatte durch einen Artikel ausgelöst, der vom gleichen Autor veröffentlicht wurde. In seiner neuesten Studie, die im März dieses Jahres veröffentlicht wurde, verglichen Makridakis und seine Kollegen die Effektivität von acht Methoden des maschinellen Lernens („ML“) mit acht einfacheren statistischen Methoden, die für Zeitreihenprognosen verwendet werden.

Die jüngste Studie wurde durch die zunehmende Beliebtheit von ML-Methoden in der Prognose veranlasst, obwohl keine ausreichenden Beweise für ihre Überlegenheit gegenüber herkömmlichen statistischen Methoden vorliegen. Aus diesem Grund wollten die Autoren testen, ob ihre ursprüngliche Behauptung, dass einfache Prognosemethoden genauer sind als komplexe Berechnungsmethoden, immer noch zutrifft.

Wichtige Begriffe

Im Großen und Ganzen versuchten die Autoren, die Prognoseleistung anhand von zwei Metriken zu messen: Genauigkeit und Rechenanforderungen. Um diese Kennzahlen besser definieren zu können, verwenden die Autoren eine Reihe von Schlüsselbegriffen, die beschreiben, wie diese Messungen durchgeführt wurden.

- Rechenkomplexität — Die Zeit, die benötigt wird, um ein bestimmtes ML anhand historischer Daten zu trainieren

- Modellanpassung — Ein Maß dafür, wie gut ein Modell an historische Daten „passt“

- Genauigkeitsmaße — In der Studie werden zwei Messgrößen für die Prognoseleistung verwendet:

- Symmetrischer mittlerer absoluter prozentualer Fehler (sMAPE)

- Mittlerer absoluter skalierter Fehler (MASE)

- Datenvorverarbeitung — Die Arbeit, die an einem Datensatz erledigt werden muss, bevor er für ML-Modellierungszwecke verwendet werden kann.

Wichtigste Ergebnisse

Das Papier selbst erstreckt sich über 20 Seiten und enthält eine detaillierte Aufschlüsselung und einen Vergleich der Genauigkeit der verschiedenen analysierten Prognosemethoden. Einige der wichtigsten Ergebnisse der Studie kommen zu dem Schluss:

1. Einfach ist immer noch besser

Die in dieser Studie enthaltenen Untersuchungen zeigten, dass die einfacheren statistischen Prognosemethoden die ML-Methoden bei beiden Genauigkeitsmaßen, die für alle untersuchten Prognosehorizonte verwendet wurden, „dominierten“. Die einfachste Methode der statistischen Prognose war die naive Methode, bei der es sich im Wesentlichen um eine Übertragung historischer Daten handelt. Die naive Methode schnitt bei Prognosen, die nur einen Schritt voraus waren, besser ab als alle ML-Methoden mit Ausnahme von drei. Dabei wurden beide Genauigkeitsmaße verwendet, und die Rechenkomplexität war deutlich geringer.

2. Rechenkomplexität

Die Autoren heben die übermäßige Rechenkomplexität einiger ML-Methoden als Hindernis für ihre praktische Anwendung hervor. Damit diese Methoden in Unternehmen und anderen Bereichen eingesetzt werden können, „müssen ihre Rechenanforderungen erheblich reduziert werden“. Der Bericht schlägt vor, Daten zu entsaisonalisieren, einfachere Modelle zu verwenden und die Anzahl der Trainingswiederholungen zu begrenzen, um die Rechenkomplexität zu reduzieren.

3. Die am besten passenden Modelle liefern keine besten Prognosen

ML-Prognosetechniken „passen“ in der Regel eine Linie oder ein Modell an historische Daten an und verwenden diese, um in die Zukunft zu extrapolieren. Ein Maß für die Effektivität einer ML-Technik ist, wie gut sie dieses Modell an historische Daten anpassen kann. Diese Studie zeigt, dass Methoden oder Modelle, die am besten zu einem Datensatz passen, nicht unbedingt zu genaueren Prognosen führten.

4. Müssen Sie die Black Box öffnen

Einer der wichtigsten Vorschläge in diesem Artikel ist, dass ML-Prognosemethoden, damit sie in praktischen Geschäftsanwendungen nützlich werden, ihre Funktionsweise und die Art und Weise, wie sie Ergebnisse liefern, für die Benutzer klarer sein müssen. Die Forscher stellten fest, dass „das Abrufen von Zahlen aus einer Blackbox für Praktiker, die wissen müssen, wie Prognosen entstehen und wie sie beeinflusst oder angepasst werden können, um zu praktikablen Prognosen zu gelangen, nicht akzeptabel ist.“

5. Automatisieren Sie Vorverarbeitungsaufgaben

Die Vorverarbeitung historischer Daten ist zeitaufwändig und erfordert Entscheidungen des Benutzers, die die Komplexität des gesamten Prognoseprozesses erhöhen. Die Automatisierung dieser Vorverarbeitungsaufgaben wird als Schlüssel dafür angesehen, dass ML-Prognosetechniken für Benutzer im Alltag nützlich werden.

Auf dem Weg zu spezialisierten Algorithmen

Das Papier beleuchtet zwar die Unzulänglichkeiten der ML-Prognosemethoden, Makridakis und seine Kollegen heben jedoch das „große Potenzial von ML für Prognoseanwendungen“ hervor. Die Schlußfolgerung dieses Papiers bekräftigt diesen Punkt und erwähnt, dass „spezielle Algorithmen“, die es nur bei Prognosen gibt, erforderlich sein könnten, um ML als praktikable Prognosetechnik zu rechtfertigen. Derzeit sind die einfachsten statistischen Methoden der Zeitreihenprognose jedoch die effektivsten.

Einsatz der neuesten Technologien

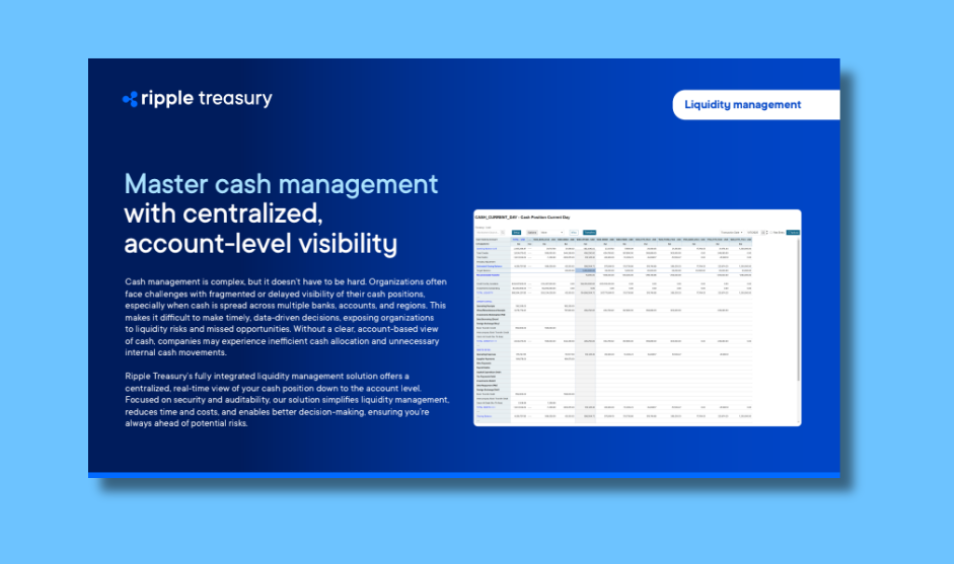

Wir bei Ripple Treasury, unterstützt von GTreasury, glauben, dass Prognosen mit keiner anderen Geschäftsdisziplin oder Aufgabe vergleichbar sind. Im Gegensatz zu vielen anderen Geschäftsprozessen wird das Endergebnis anhand von Genauigkeitsgraden (und anderen Faktoren) gemessen und nicht als binäres Richtig oder Falsch.

Als Technologieunternehmen und als engagiertes Unternehmen Spezialisten für Liquiditätsprognosen, es ist unsere Pflicht, auf dem neuesten Stand zu sein, um sicherzustellen, dass unsere Kunden von dem Besten profitieren, was die Technologie zu bieten hat. Das bedeutet, die Anwendung neuer Technologien gründlich zu testen und ihre Vor- und Nachteile zu messen. Wie Makridakis glauben wir das empirische Analyse ist das beste Maß für die Wirksamkeit.

Arten einfacher Prognosemethoden für das Corporate Treasury

1979 veröffentlichte der griechische Akademiker Spyros Makridakis eine Artikel im Journal der Royal Statistical Society. Der Artikel zeigte, dass einfache (traditionelle statistische) Prognosemethoden komplexere Methoden übertrafen. Zu dieser Zeit hatte die Zunahme der leicht zugänglichen Rechenleistung dazu geführt, dass sich neuere, rechnergestützte und offenbar genauere Prognosemethoden in Wirtschaft und Wissenschaft verbreitet hatten. Makridakis, der zu diesem Zeitpunkt Professor an der Stattdessen, stand dem wahren Wert dieser komplexeren Prognosemethoden skeptisch gegenüber, was ihn dazu veranlasste, die umfangreiche empirische Studie hinter dem Artikel in Angriff zu nehmen.

Die Ergebnisse der Studie von Makridakis wurden zu dieser Zeit vielfach kritisiert, vor allem aufgrund der Überzeugung, dass Komplexität und höhere Rechenleistung zu genaueren Ergebnissen führen müssen. Die anschließende Uneinigkeit führte zur Gründung der „M“ -Reihe von Prognosewettbewerben, bei denen die genauesten Prognosemethoden für verschiedene Arten von Vorhersagen gefunden werden sollten. Seit 1982 gab es insgesamt vier „M-Wettbewerbe“, von denen der letzte im Mai dieses Jahres abgeschlossen wurde. Der Gewinner dieses Wettbewerbs wird im Oktober bekannt gegeben.

40 Jahre später wurde eine ähnliche Debatte durch einen Artikel ausgelöst, der vom gleichen Autor veröffentlicht wurde. In seiner neuesten Studie, die im März dieses Jahres veröffentlicht wurde, verglichen Makridakis und seine Kollegen die Effektivität von acht Methoden des maschinellen Lernens („ML“) mit acht einfacheren statistischen Methoden, die für Zeitreihenprognosen verwendet werden.

Die jüngste Studie wurde durch die zunehmende Beliebtheit von ML-Methoden in der Prognose veranlasst, obwohl keine ausreichenden Beweise für ihre Überlegenheit gegenüber herkömmlichen statistischen Methoden vorliegen. Aus diesem Grund wollten die Autoren testen, ob ihre ursprüngliche Behauptung, dass einfache Prognosemethoden genauer sind als komplexe Berechnungsmethoden, immer noch zutrifft.

Wichtige Begriffe

Im Großen und Ganzen versuchten die Autoren, die Prognoseleistung anhand von zwei Metriken zu messen: Genauigkeit und Rechenanforderungen. Um diese Kennzahlen besser definieren zu können, verwenden die Autoren eine Reihe von Schlüsselbegriffen, die beschreiben, wie diese Messungen durchgeführt wurden.

- Rechenkomplexität — Die Zeit, die benötigt wird, um ein bestimmtes ML anhand historischer Daten zu trainieren

- Modellanpassung — Ein Maß dafür, wie gut ein Modell an historische Daten „passt“

- Genauigkeitsmaße — In der Studie werden zwei Messgrößen für die Prognoseleistung verwendet:

- Symmetrischer mittlerer absoluter prozentualer Fehler (sMAPE)

- Mittlerer absoluter skalierter Fehler (MASE)

- Datenvorverarbeitung — Die Arbeit, die an einem Datensatz erledigt werden muss, bevor er für ML-Modellierungszwecke verwendet werden kann.

Wichtigste Ergebnisse

Das Papier selbst erstreckt sich über 20 Seiten und enthält eine detaillierte Aufschlüsselung und einen Vergleich der Genauigkeit der verschiedenen analysierten Prognosemethoden. Einige der wichtigsten Ergebnisse der Studie kommen zu dem Schluss:

1. Einfach ist immer noch besser

Die in dieser Studie enthaltenen Untersuchungen zeigten, dass die einfacheren statistischen Prognosemethoden die ML-Methoden bei beiden Genauigkeitsmaßen, die für alle untersuchten Prognosehorizonte verwendet wurden, „dominierten“. Die einfachste Methode der statistischen Prognose war die naive Methode, bei der es sich im Wesentlichen um eine Übertragung historischer Daten handelt. Die naive Methode schnitt bei Prognosen, die nur einen Schritt voraus waren, besser ab als alle ML-Methoden mit Ausnahme von drei. Dabei wurden beide Genauigkeitsmaße verwendet, und die Rechenkomplexität war deutlich geringer.

2. Rechenkomplexität

Die Autoren heben die übermäßige Rechenkomplexität einiger ML-Methoden als Hindernis für ihre praktische Anwendung hervor. Damit diese Methoden in Unternehmen und anderen Bereichen eingesetzt werden können, „müssen ihre Rechenanforderungen erheblich reduziert werden“. Der Bericht schlägt vor, Daten zu entsaisonalisieren, einfachere Modelle zu verwenden und die Anzahl der Trainingswiederholungen zu begrenzen, um die Rechenkomplexität zu reduzieren.

3. Die am besten passenden Modelle liefern keine besten Prognosen

ML-Prognosetechniken „passen“ in der Regel eine Linie oder ein Modell an historische Daten an und verwenden diese, um in die Zukunft zu extrapolieren. Ein Maß für die Effektivität einer ML-Technik ist, wie gut sie dieses Modell an historische Daten anpassen kann. Diese Studie zeigt, dass Methoden oder Modelle, die am besten zu einem Datensatz passen, nicht unbedingt zu genaueren Prognosen führten.

4. Müssen Sie die Black Box öffnen

Einer der wichtigsten Vorschläge in diesem Artikel ist, dass ML-Prognosemethoden, damit sie in praktischen Geschäftsanwendungen nützlich werden, ihre Funktionsweise und die Art und Weise, wie sie Ergebnisse liefern, für die Benutzer klarer sein müssen. Die Forscher stellten fest, dass „das Abrufen von Zahlen aus einer Blackbox für Praktiker, die wissen müssen, wie Prognosen entstehen und wie sie beeinflusst oder angepasst werden können, um zu praktikablen Prognosen zu gelangen, nicht akzeptabel ist.“

5. Automatisieren Sie Vorverarbeitungsaufgaben

Die Vorverarbeitung historischer Daten ist zeitaufwändig und erfordert Entscheidungen des Benutzers, die die Komplexität des gesamten Prognoseprozesses erhöhen. Die Automatisierung dieser Vorverarbeitungsaufgaben wird als Schlüssel dafür angesehen, dass ML-Prognosetechniken für Benutzer im Alltag nützlich werden.

Auf dem Weg zu spezialisierten Algorithmen

Das Papier beleuchtet zwar die Unzulänglichkeiten der ML-Prognosemethoden, Makridakis und seine Kollegen heben jedoch das „große Potenzial von ML für Prognoseanwendungen“ hervor. Die Schlußfolgerung dieses Papiers bekräftigt diesen Punkt und erwähnt, dass „spezielle Algorithmen“, die es nur bei Prognosen gibt, erforderlich sein könnten, um ML als praktikable Prognosetechnik zu rechtfertigen. Derzeit sind die einfachsten statistischen Methoden der Zeitreihenprognose jedoch die effektivsten.

Einsatz der neuesten Technologien

Wir bei Ripple Treasury, unterstützt von GTreasury, glauben, dass Prognosen mit keiner anderen Geschäftsdisziplin oder Aufgabe vergleichbar sind. Im Gegensatz zu vielen anderen Geschäftsprozessen wird das Endergebnis anhand von Genauigkeitsgraden (und anderen Faktoren) gemessen und nicht als binäres Richtig oder Falsch.

Als Technologieunternehmen und als engagiertes Unternehmen Spezialisten für Liquiditätsprognosen, es ist unsere Pflicht, auf dem neuesten Stand zu sein, um sicherzustellen, dass unsere Kunden von dem Besten profitieren, was die Technologie zu bieten hat. Das bedeutet, die Anwendung neuer Technologien gründlich zu testen und ihre Vor- und Nachteile zu messen. Wie Makridakis glauben wir das empirische Analyse ist das beste Maß für die Wirksamkeit.

Siehe GTreasury in Aktion

Nehmen Sie noch heute Kontakt mit unterstützenden Experten, umfassenden Lösungen und ungenutzten Möglichkeiten auf.

.jpg)

.jpeg)

.jpeg)

.jpeg)

.jpeg)

.jpeg)

.jpeg)